爬虫逆向技术

逆向介绍

爬虫,就是在网络上自动抓取自己所需要的内容。很多人认为,爬虫技术主要是要学怎么去爬取内容,但其实,单纯的爬取网页内容(针对不设防的网站)非常简单,用Python几十行即可搞定。但理想很丰满,现实很骨感。实际上,不设防的网站少之又少,大部分信息重要程度很高的网站都有很难突破的加密与保护措施,比如常见的各种验证码。所以,学习爬虫更重要的是如何绕过网站/APP内的反爬虫措施,从而顺利得到我们想要的数据。这个过程就是逆向。

另外,提到爬虫,很多人都会问:“写这玩意是不是容易坐牢?”。确实,爬虫这种东西本身就带了一种“不太道德”的色彩,很多网站也是深受其扰。但对于个人开发者而言,只要做的不太过分,适当的爬取内容,一般公司也不会针对个人发起诉讼。“不谈剂量谈毒性就是耍流氓”。大家掌握好一个度就可以了。

Python爬虫常用工具

在线工具

| 链接 | 简介 |

|---|---|

| https://spidertools.cn | 爬虫工具库 |

| https://www.json.cn | Json解析网站 |

| https://base64.us | Base64编码解码 |

| https://www.runoob.com/runcode | HTML代码转页面 |

| https://alisen39.com | HTTPRaw转Python |

| http://httpbin.org/get | 查看本地请求信息 |

| http://tool.chinaz.com/tools/unicode.aspx | 站长工具编码解码集合 |

| http://web.chacuo.net/netproxycheck | 代理服务器连接测试工具 |

| http://tool.yuanrenxue.com | 爬虫分析工具 |

工具库

Urllib

urllib3是python的一个扩展库,可以帮助我们安全而方便的发送网页请求。

BeautifulSoup

BeautifulSoup是python的一个库,其提供一些简单的、python式的函数用来处理导航、搜索、修改分析树等功能。它是一个工具箱,通过解析文档为用户提供需要抓取的数据,因为简单,所以不需要多少代码就可以写出一个完整的应用程序。

BeautifulSoup4和lxml一样,BeautifulSoup也是一个HTML/XML的解析器,主要的功能也是如何解析和提取HTML/XML数据。

BeautifulSoup自动将输入文档转换为Unicode编码,输出文档转换为utf-8编码。BeautifulSoup支持Python标准库中的HTML解析器,还支持一些第三方的解析器。

Scrapy

Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架。 可以应用在包括数据挖掘,信息处理或存储历史数据等一系列的程序中。

其最初是为了页面抓取(更确切来说,网络抓取 )所设计的, 也可以应用在获取API所返回的数据(例如 Amazon Associates Web Services ) 或者通用的网络爬虫。

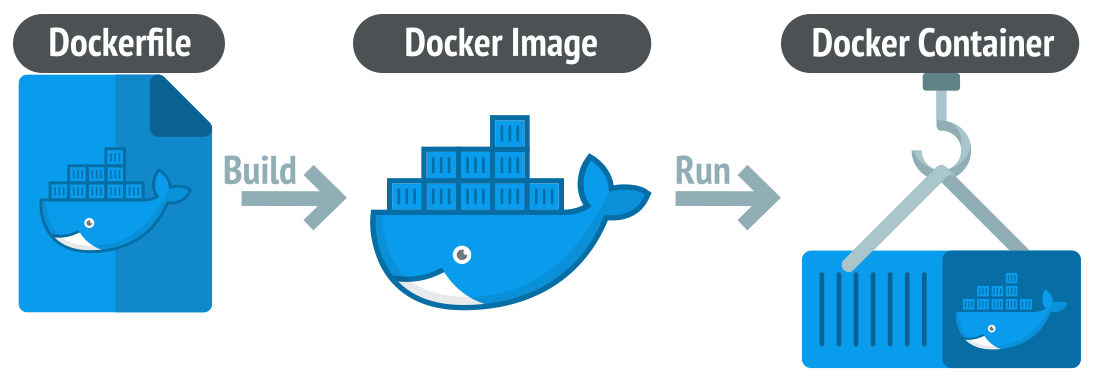

它的架构如下:

1. Scrapy Engine

引擎负责控制数据流在系统中所有组件中流动,并在相应动作发生时触发事件。 详细内容查看下面的数据流(Data Flow)部分。此组件相当于爬虫的“大脑”,是整个爬虫的调度中心。

2. 调度器 Scheduler

调度器从引擎接受request并将他们入队,以便之后引擎请求他们时提供给引擎。

初始的爬取URL和后续在页面中获取的待爬取的URL将放入调度器中,等待爬取。同时调度器会自动去除重复的URL(如果特定的URL不需要去重也可以通过设置实现,如post请求的URL)

3. 下载器 Downloader

下载器负责获取页面数据并提供给引擎,而后提供给spider。

4. Spiders

Spider是Scrapy用户编写用于分析response并提取item(即获取到的item)或额外跟进的URL的类。 每个spider负责处理一个特定(或一些)网站。

5. Item Pipeline

Item Pipeline负责处理被spider提取出来的item。典型的处理有清理、 验证及持久化(例如存取到数据库中)。

当页面被爬虫解析所需的数据存入Item后,将被发送到项目管道(Pipeline),并经过几个特定的次序处理数据,最后存入本地文件或存入数据库。

6. 下载器中间件

下载器中间件是在引擎及下载器之间的特定钩子(specific hook),处理Downloader传递给引擎的response。 其提供了一个简便的机制,通过插入自定义代码来扩展Scrapy功能。通过设置下载器中间件可以实现爬虫自动更换user-agent、IP等功能。

7. Spider中间件

Spider中间件是在引擎及Spider之间的特定钩子(specific hook),处理spider的输入(response)和输出(items及requests)。 其提供了一个简便的机制,通过插入自定义代码来扩展Scrapy功能。

8. 数据流 Data flow

- 引擎打开一个网站(open a domain),找到处理该网站的Spider并向该spider请求第一个要爬取的URL(s)。

- 引擎从Spider中获取到第一个要爬取的URL并在调度器(Scheduler)以Request调度。

- 引擎向调度器请求下一个要爬取的URL。

- 调度器返回下一个要爬取的URL给引擎,引擎将URL通过下载中间件(请求(request)方向)转发给下载器(Downloader)。

- 一旦页面下载完毕,下载器生成一个该页面的Response,并将其通过下载中间件(返回(response)方向)发送给引擎。

- 引擎从下载器中接收到Response并通过Spider中间件(输入方向)发送给Spider处理。

- Spider处理Response并返回爬取到的Item及(跟进的)新的Request给引擎。

- 引擎将(Spider返回的)爬取到的Item给Item Pipeline,将(Spider返回的)Request给调度器。

- (从第二步)重复直到调度器中没有更多地request,引擎关闭该网站。

代理IP工具

Proxy_pool

Github:https://github.com/jhao104/proxy_pool

爬虫代理IP池项目,主要功能为定时采集网上发布的免费代理验证入库,定时验证入库的代理保证代理的可用性,提供API和CLI两种使用方式。同时也可以扩展代理源以增加代理池IP的质量和数量。

Web Js 逆向

在前后端分离的开发方式中,为保证接口调用时的数据安全性,也为了防止请求参数被篡改,大多数接口都进行了请求签名、身份认证、动态Cookie等机制。另外部分网站对返回的数据也会进行加密。

这些加密参数的生成方法都是由Js来控制的,如果想直接从接口获取数据,就要去分析调试JavaScript的调用逻辑、堆栈调用关系来弄清网站加密的实现方法。

Js作用域

Js作用域分为三种:全局作用域,函数作用域,块级作用域。

全局作用域

最外层函数和在最外层函数外面定义的变量拥有全局作用域。

1 | var outName = '我是最外层变量' //最外层变量 |

所有未定义直接赋值的变量自动声明为拥有全局作用域。

1 | function outFun() { |

所有 window 对象的属性拥有全局作用域。

1 | //全局作用域弊端:会造成污染全局命名空间, 容易引起命名冲突 |

函数作用域

函数内部定义的变量

块级作用域

if 和 switch 的条件语句或 for 和 while 的循环语句中。

也可通过新增的let和const声明。

窗口对象属性

很多环境监测都是基于浏览器window的属性和方法。

Window

Window对象表示浏览器当前打开的窗口。

未完待续…